pg娱乐城

一、从生活中理解马尔可夫链

想象您每天早上出门时需要决定穿什么衣服。如果今天是晴天,您有80%的概率明天也是晴天,20%的概率变成雨天;如果今天是雨天,您有60%的概率明天变成晴天,40%的概率继续下雨。在这个简单的例子中,明天的天气只取决于今天的天气,而与前天、大前天的天气无关。这种"只看当前状态,不管过去历史"的特性,就是马尔可夫链最核心的数学性质——无记忆性(Markov Property)。

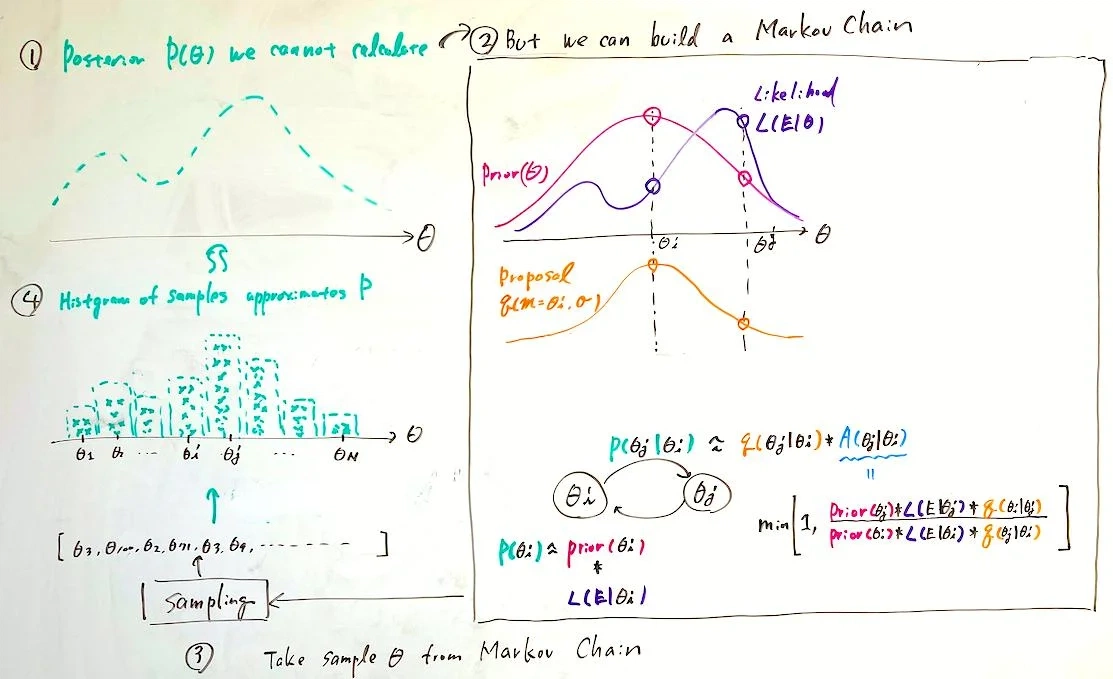

图1:马尔可夫链状态转移示意图 - 每个节点代表一个状态,箭头上的数字代表转移概率

马尔可夫链由俄国数学家安德烈·马尔可夫(Andrey Markov)在1906年首次提出,至今已成为概率论和随机过程中最基础也最重要的数学工具之一。它的应用范围极其广泛,从天气预报、股票市场分析到搜索引擎排名算法(Google的PageRank就是一个巨大的马尔可夫链),再到我们今天要讨论的PG电子游戏算法设计。

pg娱乐城

二、马尔可夫链的数学定义

用数学语言来说,马尔可夫链是一个满足马尔可夫性质的随机过程。设{X_n, n=0,1,2,...}是一个取值在状态空间S中的随机序列,如果对于所有的n和所有的状态i_0, i_1, ..., i_n, j,都满足以下条件:

即:未来状态的概率分布只依赖于当前状态,与过去的状态序列无关。

转移概率矩阵P是描述马尔可夫链行为的核心工具。矩阵中的每个元素p_ij表示从状态i转移到状态j的概率。这个矩阵的每一行之和必须等于1(因为从任何状态出发,必须转移到某个状态)。通过对转移概率矩阵进行幂运算,我们可以计算出经过n步后从任意状态到达任意其他状态的概率。

pg娱乐城

三、马尔可夫链在PG电子游戏中的应用

在PG电子游戏中,马尔可夫链被用来建模游戏的状态转移系统。一款典型的PG电子游戏可以被分解为以下几个核心状态:普通旋转模式(Base Game)、免费旋转触发判定、免费旋转进行中、奖金游戏模式和大奖结算。每次旋转后,游戏根据预设的转移概率矩阵决定下一步进入哪个状态。

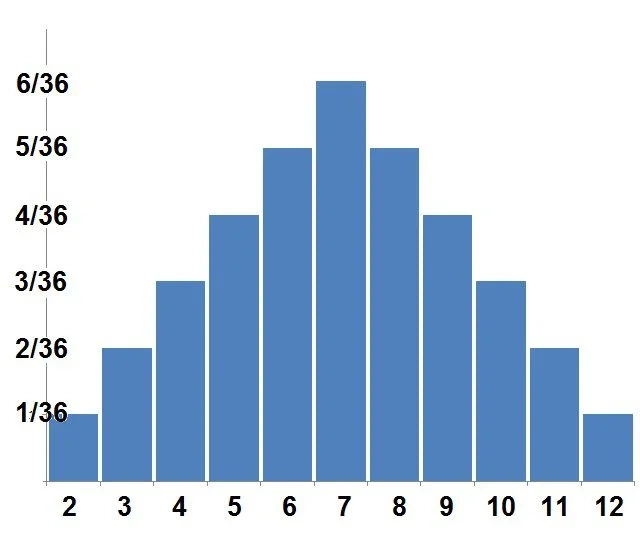

图2:概率分布图 - 展示不同状态之间的转移概率分布

这种设计的精妙之处在于:游戏设计者可以通过调整转移概率矩阵中的参数,精确控制游戏的多个关键指标。例如,增加从普通模式到免费旋转模式的转移概率,会提高免费旋转的触发频率,从而影响游戏的波动率和玩家体验。减少免费旋转模式的自我延续概率,会缩短免费旋转的平均持续时间,从而降低单次免费旋转的平均赢奖。所有这些调整都必须在一个约束条件下进行——最终的长期RTP必须等于预设的目标值。

pg娱乐城

四、稳态分布与RTP的关系

马尔可夫链的一个重要性质是,在满足一定条件(不可约、非周期)时,无论从哪个状态出发,经过足够长的时间后,系统会收敛到一个唯一的稳态分布(Stationary Distribution)。这个稳态分布告诉我们,在长期运行中,系统处于每个状态的时间比例。

其中 P 为转移概率矩阵

游戏的长期RTP可以表示为:

RTP = Σ πi × E[回报|状态i] / E[投注|状态i]

即各状态的稳态概率加权平均回报率

在PG电子游戏中,稳态分布直接决定了游戏的长期RTP。例如,如果稳态分布显示游戏有95%的时间处于普通模式(RTP贡献约为60%)、4%的时间处于免费旋转模式(RTP贡献约为35%)、1%的时间处于大奖模式(RTP贡献约为5%),那么整体RTP就是这三个部分的加权和。游戏设计者通过精确计算稳态分布,确保最终的RTP达到目标值。

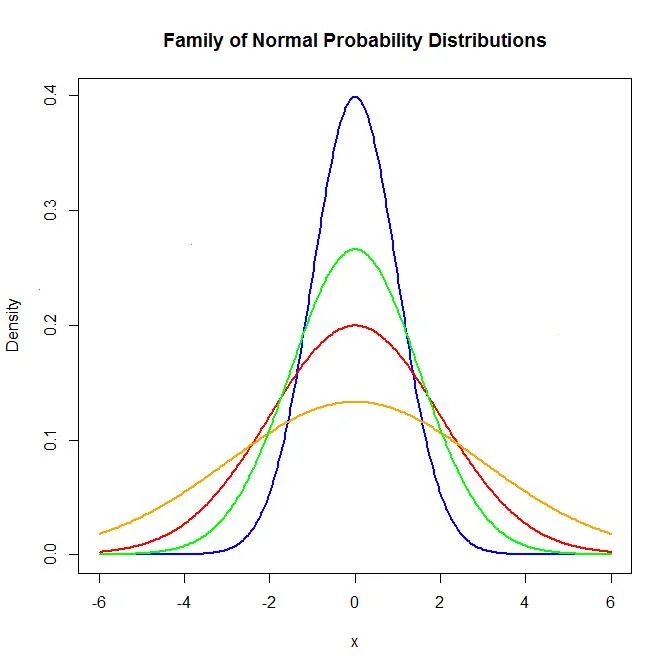

图3:稳态分布收敛过程 - 无论初始状态如何,最终都会收敛到相同的稳态分布

pg娱乐城

五、为什么理解马尔可夫链很重要?

理解马尔可夫链对于科学地分析PG电子游戏具有重要意义。首先,它解释了为什么每次旋转的结果是独立的——马尔可夫性质保证了下一次旋转的结果只取决于当前的游戏状态,而不受之前赢输历史的影响。这意味着所谓的"冷机"和"热机"理论在数学上是站不住脚的。其次,它解释了为什么短期体验可能与长期RTP大相径庭——在马尔可夫链收敛到稳态之前,系统可能长时间停留在某些状态,造成短期内的极端波动。最后,它为我们提供了一个严谨的数学框架来分析和验证游戏的公平性。

如果您想更深入地了解马尔可夫链的数学理论,我们推荐阅读J.R. Norris的经典教材《Markov Chains》(Cambridge University Press),以及我们在《麻将胡了》算法解析中对马尔可夫决策过程的实际应用案例。